Resumo Rápido:

- Senadores americanos enviaram uma carta exigindo explicações detalhadas de X, Meta, Alphabet, Snap, Reddit e TikTok sobre o combate a deepfakes íntimas.

- O Grok, IA de Elon Musk, está no centro da polêmica após falhas graves em seus filtros de segurança.

- O conteúdo é indicado para usuários que buscam entender o futuro da privacidade e as novas leis de inteligência artificial.

Fala, pessoal! Aqui é o Filipe Reis. Se você acompanha o UzTech, sabe que eu sou um muito fã da inteligência artificial, mas nem tudo são flores nesse jardim tecnológico. O “velho oeste” das IAs generativas está começando a encontrar a lei, e o xerife da vez é o Senado dos Estados Unidos.

Recentemente, um grupo de senadores americanos decidiu que chega de “pedir por favor”. Eles enviaram uma carta contundente para os líderes das maiores plataformas do mundo — incluindo X (antigo Twitter), Meta, Alphabet (Google), Snap, Reddit e TikTok — exigindo provas concretas de que essas empresas possuem políticas robustas para conter a onda de deepfakes sexualizadas não consensuais.

O problema não é novo, mas a facilidade com que qualquer pessoa pode “despir” outra virtualmente usando ferramentas de IA atingiu um nível muito preocupante. Vamos mergulhar nos detalhes dessa movimentação que promete sacudir o Vale do Silício.

O ultimato dos senadores: o que eles querem saber?

A carta não é apenas um “puxão de orelha”. Os senadores Lisa Blunt Rochester, Richard Blumenthal e outros seis parlamentares exigiram que as empresas preservem todos os documentos relacionados à criação, detecção, moderação e — o ponto mais sensível — a monetização de imagens geradas por IA com teor sexual.

Eles querem respostas para perguntas bem específicas, como:

- Qual é a definição oficial da empresa para “conteúdo deepfake”?

- Como as ferramentas de IA são impedidas de gerar nudes de pessoas reais?

- Quais mecanismos existem para evitar que usuários lucrem com esse tipo de crime?

- Como as vítimas são notificadas quando um conteúdo desses é detectado?

É uma abordagem de 360 graus. O governo americano percebeu que as “barreiras de proteção” (os famosos guardrails) que as empresas dizem ter são, na prática, tão eficazes quanto uma peneira tentando segurar água.

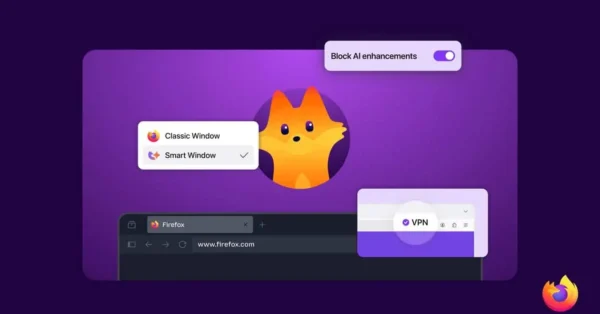

O caso Grok e a pressão sobre Elon Musk

Se existe um vilão nessa história recente, para os reguladores, ele atende pelo nome de Grok. A IA da xAI (empresa de Elon Musk integrada ao X) foi duramente criticada por permitir que usuários gerassem imagens sexualizadas de figuras públicas e até de crianças com uma facilidade assustadora.

Musk chegou a dizer que “não estava ciente” de imagens de menores geradas pelo Grok, mas a pressão foi tanta que o X teve que atualizar a ferramenta às pressas, proibindo edições de pessoas reais em roupas reveladoras e restringindo a criação de imagens apenas para assinantes pagantes.

A situação escalou tanto que o Procurador-Geral da Califórnia abriu uma investigação oficial sobre o chatbot. É o tipo de dor de cabeça que nem todo o dinheiro do mundo de Musk consegue resolver facilmente se as leis de segurança infantil forem violadas.

O histórico do problema nas plataformas

Embora o Grok seja o alvo atual, a verdade é que o problema das deepfakes é sistêmico. Veja como as principais plataformas têm lidado (ou falhado) com o tema:

| Plataforma | Histórico / Problema Recente | Status da Resposta |

|---|---|---|

| Berço das deepfakes de celebridades em 2018. | Baniu comunidades específicas, mas o conteúdo persiste. | |

| Meta (Instagram/FB) | Permitiu anúncios de apps de “nudez artificial”. | Processou a CrushAI, mas o Conselho de Supervisão cobra mais agilidade. |

| Snapchat | Relatos de adolescentes espalhando deepfakes de colegas. | Sob pressão para melhorar filtros de segurança para menores. |

| TikTok / YouTube | Hospedam deepfakes que geralmente vêm de outras redes. | Lutam com a velocidade de re-upload de vídeos virais. |

A falha das leis atuais e o que vem por aí

Você pode estar se perguntando: “Mas Filipe, não existe lei para isso?”. Sim e não. Em maio, foi aprovado o Take It Down Act nos EUA, que criminaliza a criação e disseminação de imagens íntimas não consensuais. O problema é que essa lei foca muito no usuário individual e deixa brechas que protegem as plataformas de serem responsabilizadas diretamente.

É por isso que estados como Nova York estão tentando tomar as rédeas. A governadora Kathy Hochul propôs leis que exigem a rotulagem obrigatória de qualquer conteúdo gerado por IA e o banimento total de deepfakes durante períodos eleitorais.

O grande desafio técnico é que, enquanto as empresas do Ocidente tentam se regular, ferramentas vindas da China (especialmente ligadas à ByteDance) e bots do Telegram (que nem entrou na lista dos senadores, mas é um antro de apps de “virtual undressing”) continuam operando sem qualquer freio.

Por que isso importa para você?

Mesmo que você não seja uma celebridade, a tecnologia de “nudes falsos” está se tornando democrática demais. Hoje, uma foto comum de rede social pode ser usada por um mal-intencionado para criar um conteúdo degradante em segundos. A pressão do Senado sobre as Big Techs é a tentativa de forçar essas empresas a assumirem a responsabilidade pelo monstro que ajudaram a criar ao liberar ferramentas de IA sem os devidos testes de segurança.

Concluindo…

Estamos vivendo um momento de transição. A inteligência artificial é incrível, mas a falta de ética em sua implementação pode destruir vidas em tempo recorde. A exigência de transparência por parte dos senadores americanos é um passo necessário para que a internet volte a ser um lugar minimamente seguro. Se as empresas não conseguem se policiar, o Estado terá que fazer isso por elas — e a conta costuma vir alta em forma de multas e restrições pesadas.

Acredita que as redes sociais devem ser punidas legalmente pelas deepfakes criadas em suas plataformas? Compartilhe sua opinião nos comentários!

FAQ

O que são deepfakes sexualizadas?

São imagens ou vídeos criados por inteligência artificial que inserem o rosto de uma pessoa real em corpos nus ou atos sexuais sem o seu consentimento.

Como o Grok do X está envolvido na polêmica?

A IA de Elon Musk foi criticada por ter poucos filtros de segurança, permitindo que usuários gerassem imagens íntimas de figuras públicas e até simulações de abuso de menores.

Existe uma lei federal contra deepfakes?

Nos EUA, existe o “Take It Down Act”, mas ele ainda é considerado limitado por focar nos usuários e não responsabilizar diretamente as plataformas que hospedam ou facilitam a criação do conteúdo.

Vale a pena confiar nos filtros de segurança das redes sociais?

Atualmente, não totalmente. Como apontado pelos senadores, os usuários frequentemente encontram formas de burlar os filtros (guardrails) das IAs generativas.

Como posso me proteger de deepfakes?

A melhor forma é manter perfis privados e evitar postar fotos em alta resolução que mostrem claramente o rosto em ângulos variados, embora a responsabilidade final deva ser das plataformas e da legislação.